هوش مصنوعی مولد، چشمانداز امنیت سایبری را دگرگون کرده و مهاجمان با بهرهگیری از مدلهای زبانی بزرگ (LLM) به جعل هویت افراد مورد اعتماد و اجرای مهندسی اجتماعی در مقیاس گسترده روی آوردهاند.

رشد تهدیدات مبتنی بر دیپفیک

گزارشهای اخیر افزایش پیچیدگی و شیوع حملات مبتنی بر هوش مصنوعی را نشان میدهند:

- گزارش تهدید جهانی CrowdStrike در سال ۲۰۲۵ اعلام کرد که حملات فیشینگ صوتی (vishing) در نیمه دوم ۲۰۲۴ نسبت به نیمه اول همان سال ۴۴۲ درصد رشد داشتهاند. این افزایش به استفاده از تکنیکهای جعل هویت و فیشینگ تولیدشده توسط هوش مصنوعی نسبت داده شده است.

- گزارش ۲۰۲۵ Verizon درباره نشتهای اطلاعاتی نشان داد که مهندسی اجتماعی، بهویژه فیشینگ و جعل پیشزمینه (pretexting)، همچنان یکی از الگوهای اصلی نقضهای امنیتی است.

- گروههای هکری مرتبط با کره شمالی از فناوری دیپفیک برای ایجاد هویتهای جعلی و شرکت در مصاحبههای شغلی آنلاین استفاده کردهاند تا به مشاغل راه دور نفوذ کرده و به سازمانها دسترسی یابند.

عوامل تشدیدکننده تهدید

سه روند کلیدی جعل هویت مبتنی بر هوش مصنوعی را به تهدیدی جدی تبدیل کردهاند:

- هزینه پایین و مقیاسپذیری: ابزارهای متنباز تولید صدا و تصویر امکان جعل هویت هر فرد را تنها با چند دقیقه محتوای مرجع فراهم کردهاند.

- اعتماد در پلتفرمهای مجازی: ابزارهایی مانند Zoom، Teams و Slack فرض میکنند فرد پشت صفحه همان کسی است که ادعا میکند و مهاجمان از این فرض سوءاستفاده میکنند.

- محدودیتهای تشخیص: ابزارهای فعلی تشخیص دیپفیک به تحلیل آماری و نشانههای ظاهری متکیاند و در محیطهای حساس، این روشهای مبتنی بر احتمال کافی نیستند.

ابزارهای امنیتی سمت کاربر یا آموزش کارکنان ممکن است کمککننده باشند؛ اما پاسخگوی یک سؤال حیاتی در لحظه نیستند:

«آیا میتوانم به فردی که با او صحبت میکنم، اعتماد کنم؟»

نیاز به پیشگیری بهجای تشخیص

دفاعهای سنتی بر شناسایی متمرکزند، مانند آموزش کاربران برای تشخیص رفتار مشکوک یا تحلیل صدا و تصویر برای شناسایی جعل؛ اما با پیشرفت سریع دیپفیکها، این روشها ناکافیاند. پیشگیری مؤثر نیازمند رویکردی مبتنی بر اعتماد اثباتپذیر است که شامل موارد زیر میشود:

- تأیید هویت کاربران: تنها کاربران تأییدشده با گواهیهای رمزنگاریشده نه صرفا با رمز عبور، باید به جلسات حساس دسترسی داشته باشند،

- بررسی یکپارچگی دستگاه: دستگاههای آلوده یا دستکاریشده (مانند دستگاههای جیلبریکشده) حتی در صورت اینکه تایید شده باشند، باید تا رفع مشکل از دسترسی منع شوند.

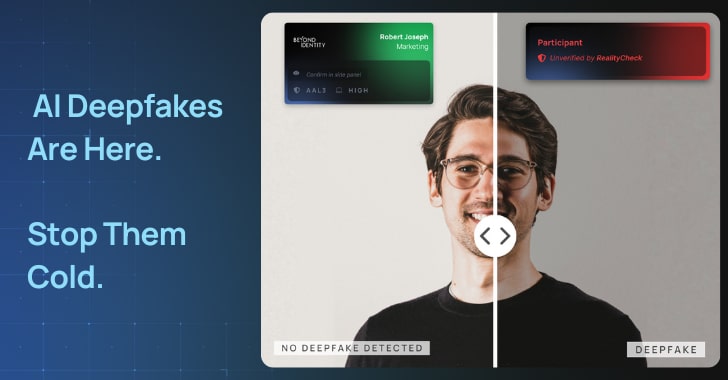

- نمایش شاخصهای اعتماد: شرکتکنندگان باید بتوانند با نشانههای بصری تأییدشده، هویت واقعی و امنیت دستگاه سایر افراد حاضر در جلسه را مشاهده کنند.

این رویکرد جعل هویت را نهتنها دشوار، بلکه عملا غیرممکن میکند و از حضور دیپفیکها در جلسات حساس، تراکنشهای مالی، یا همکاریهای تجاری جلوگیری میکند.

ابزار RealityCheck

ابزار RealityCheck از شرکت Beyond Identity برای رفع شکاف اعتماد در ابزارهای تعاملی طراحی شده است. این ابزار به هر شرکتکننده یک نشان هویتی تأییدشده ارائه میدهد که با احراز هویت رمزنگاریشده و بررسی مستمر ریسک دستگاه پشتیبانی میشود. ویژگیهای RealityCheck شامل موارد زیر است:

- تأیید هویت واقعی و مجاز بودن شرکتکنندگان.

- بررسی لحظهای سلامت و یکپارچگی دستگاه، حتی در دستگاههای غیرمدیریتی.

- نمایش نشان بصری برای تأیید هویت و امنیت دستگاه به سایر شرکتکنندگان.

در حال حاضر، RealityCheck برای Zoom و Microsoft Teams (در حالت ویدیو و چت) قابل استفاده است و رویکردی پیشگیرانه برای حذف دیپفیکها از جلسات حساس ارائه میدهد.